Au départ, cette histoire commence par une confusion avec l’image de la boîte noire, qui s’avère en réalité être la Kaaba, un cube noir situé au centre de la Mosquée sacrée à La Mecque. Avant la conquête de La Mecque par Mahomet, la Kaaba servait de lieu de conservation pour de nombreux symboles sacrés de différentes croyances régionales. À l’époque, elle représentait un centre spirituel universel où les gens cherchaient protection et bénédiction dans diverses situations de vie.

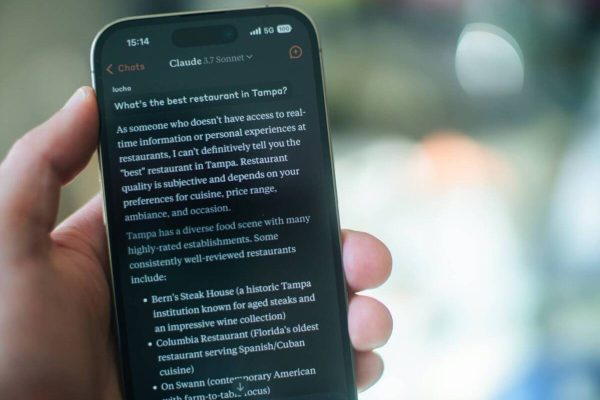

L’auteur établit un parallèle avec ce que fait aujourd’hui Anthropic avec son modèle Claude. La semaine dernière, la société a participé avec OpenAI à une table ronde à New York intitulée « Le Testament de la Foi et l’IA », réunissant des représentants de diverses organisations religieuses et spirituelles, y compris des communautés juives, hindoues, sikhes, orthodoxes et d’autres.

Dialogues interconfessionnels pour une IA éthique

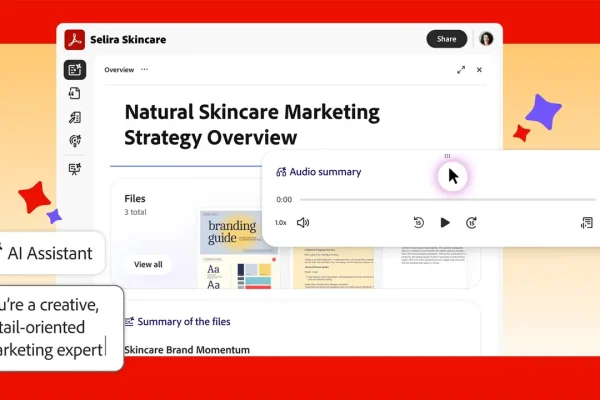

Cette rencontre s’inscrit dans le prolongement des initiatives antérieures d’Anthropic, qui avait déjà consulté des leaders chrétiens pour discuter du possible « développement moral » de ses modèles. L’entreprise souhaite impliquer des représentants de différentes doctrines religieuses et traditions philosophiques afin de mieux comprendre les limites éthiques du comportement de l’intelligence artificielle.

Selon Associated Press, l’événement a été organisé par une ONG internationale dédiée aux questions de dialogue interconfessionnel et de sécurité communautaire. Il semble qu’OpenAI et Anthropic aient pris l’initiative d’établir des contacts avec les représentants religieux. Cependant, il reste incertain si ces rencontres font partie d’un programme à long terme ou s’il s’agit d’initiatives distinctes menées par différentes équipes.

Principes éthiques au-delà des règles religieuses

Aucune règle « religieuse » commune pour l’intelligence artificielle n’a été élaborée lors des discussions. L’objectif était plutôt de trouver des principes éthiques plus généraux qui pourraient aider le modèle à prendre des décisions dans des situations complexes ou ambiguës où il n’existe pas d’instructions claires. Cela constitue la base de la « constitution Claude » – un ensemble de principes destinés à guider le comportement du modèle.

Cependant, certains experts restent sceptiques face à ces approches. Ils estiment que l’idée d’« enseigner la morale » via des consultations avec des leaders religieux peut sembler séduisante mais ne garantit pas une réelle prévisibilité ou sécurité du système. À leur avis, c’est davantage une tentative de trouver une base symbolique pour un problème technique complexe qu’une solution pratique.

En fin de compte, la question reste ouverte : l’intelligence artificielle peut-elle réellement se rapprocher de principes moraux universels grâce à ces dialogues, ou est-ce simplement un moyen pour les entreprises de montrer qu’elles prennent très au sérieux l’aspect éthique du développement technologique ?